Toepassingen in Big Data kunnen, zoals we al hebben gezien het hoofdstuk Trends in deze AI cursus en de hoofdstukken Big Data en De kosten van Gratis uit de overkoepelende cursus Informatie, kan nuttig zijn maar ook een bedreiging vormen voor het individu. Maar hoe wordt de informatie geleverd door dit soort toepassingen verkregen uit de data?

De meeste van deze toepassingen gebruiken Artificiële Intelligentie om b.v. patronen te herkennen of groeperingen te maken, technieken die we zijn tegen gekomen in het hoofdstuk Technieken. In dit en de volgende hoofdstukken van de cursus gaan we een paar van die wiskundige technieken verder uitwerken. De berekeningen in dit hoofdstuk zijn niet heel erg ingewikkeld en zouden voor iedere leerling op havo en vwo uit te voeren moeten zijn. Lukt het niet stel dan vragen aan je docent.

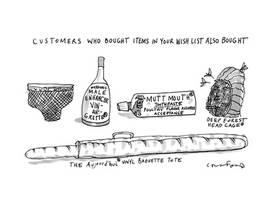

Bij associatie analyse is het de bedoeling dat we een gegeven set kenmerken (bijvoorbeeld jouw leeftijd, geslacht, ingetypte zoekopdracht, beluisterde muziek) kunnen koppelen aan een andere set kenmerken (bijvoorbeeld reclame passend bij doelgroep omschrijving, leeftijd en geslacht). Het resultaat van de associatie is dan de uitvoer van de toepassing (bijvoorbeeld de reclame die in de zoekmachine verschijnt, muziek die jij ook wel leuk zou vinden). Hieronder vind je voorbeelden van gebieden waarin associatie analyse gebruikt wordt:

| Symbolen | |

|---|---|

| Notatie | Betekenis |

| $\in$ | ’is een element van’, ’behoort tot’ |

| $\subset$ | ’is een deelverzameling van’ |

| {,} | accolades worden gebruikt om een verzameling aan te duiden |

| $\cap$ | ’doorsnede’, het gemeenschappelijke deel van de twee verzamelingen |

| $\cup$ | ’vereniging’, de elementen van de eerste en tweede verzameling worden samengenomen |

| $\#$ | ’aantal’, $\# A$ is het aantal elementen in $A$. |

| $\Rightarrow$ | ’implicatie’, al links waar is dan is ook rechts waar. |

De wiskundige techniek die wordt gebruikt in associatie analyse is gebaseerd op wiskunde op verzamelingen, de zogenaamde verzamelingenleer. Laten we eens kijken wat verzamelingen zijn en hoe we die gaan inzetten in de associatie analyse.

Als leerling zit je in een klas, als voetballer zit je in een team, je ‘play list’ bevat een

aantal leuke liedjes, .... Zo kunnen we nog een tijd doorgaan met het geven van voorbeelden.

Voorbeelden die allemaal gaan over verzamelingen.

In plaats van een ‘klas’, ‘team’, ‘play list’ spreken we van een verzameling ($V$) (ook wel: set).

In een verzameling bevindt zich elementen (leerlingen, spelers, liedjes). We noteren een verzameling als volgt:

$$V=\{v_{1},v_{2},v_{3},\cdots ,v_{n}\}.$$

Een verzameling bestaat dus uit elementen, en als $x$

een element is van een verzameling $X$ noteren we dit wiskundig als $x \in X$.

Als voor twee verzamelingen $X$ en $Y$ geldt dat elk element van $X$ ook een element is van $Y$, dan zeggen we dat $X$ een deelverzameling (subset) is van $Y$.

Notatie: $X \subset Y$

Zo geldt bijvoorbeeld voor $X=\{Melk , Kaas\}$ en $Y = \{Melk , Brood , Kaas\}$ dat $X \subset Y$, $X$ is een deelverzameling van $Y$.

De doorsnede (intersection) $X \cap Y$ van twee verzamelingen $X$ en $Y$ bestaat uit de gemeenschappelijke elementen van $X$ en $Y$.

In de figuur links is de doorsnede het lichtgroene gebied.

Zo is bijvoorbeeld $\{Melk , Brood , Kaas\} \cap \{Melk , Brood , Pindakaas\}$

de verzameling met de elementen $Melk$ en $Brood$.

De vereniging (union) $X \cup Y$ van twee verzamelingen $X$ en $Y$ bestaat uit de elementen die tot $X$, tot $Y$ of tot beide horen.

In de figuur links bestaat de vereniging uit alle enigszins gele gebieden.

Zo is bijvoorbeeld $\{Melk , Brood , Kaas\}\cup\{Melk , Brood , Pindakaas\}$ de verzameling met de

elementen $Kaas, Melk, Brood$ en $Pindakaas$. $\{Melk , Brood , Kaas\}\cup\{Melk , Brood , Pindakaas\} = \{Kaas, Melk, Brood, Pindakaas\}$

Voor een eindige verzameling $A$ definieren we $\#A$ als het aantal elementen in $A$. Zo is bijvoorbeeld

$\#\{Chips,Zeep,Appels\}=3$.

Een element van een verzameling kan zelf ook een verzameling zijn. Zo bestaat de verzameling

$C= \{ \{ Chips,Zeep,Appels \}, \{Chips,Zeep,Appels\}, \{Zeep,Bananen\},\{Chips,Zeep,Bananen\}\}$ uit vier elementen.

Een verzameling waarin de elementen ook

weer verzamelingen zijn noemt men een collectie.

Verzameling $V$ bevat elementen $v$ die we kunnen nummeren.

We gebruiken accolades { en } om verzamelingen te noteren.

We gebruiken binnen de accolades het symbool | om elementen met bepaalde eigenschappen

aan te geven, zoals in $\{x \in \mathbb{N} | x \, is\, deelbaar \, door \, 2 \}$, wat betekent dat $x$ een natuurlijk getal moet zijn en deelbaar door twee (de even getallen).

Zo is bijvoorbeeld $Winkelmandje = \{Melk , Brood , Kaas\}$ de verzameling Winkelmandje met de elementen Melk, Brood, en Kaas.

Als we schrijven $Melk \in Winkelmandje$, dan zeggen we dus dat Melk in het winkelmandje aanwezig is.

Relaties tussen verzamelingen

$\{Melk , Brood , Kaas\} \cap \{Melk , Brood , Pindakaas\} = \{Melk , Brood\}$

$T1=\{banaan\}$,

$T2=\{chips\}$,

$T3=\{melk\}$,

$T4=\{pruim\}$,

$T5=\{banaan,rum\}$,

$T6=\{chips,rum\}$,

$T7=\{banaan,chips,melk\}$ en

$T8=\{banaan,rum,melk,pruim\}$

Om uitspraken te kunnen doen over verbanden tussen verzamelingen en de waarde van die verzamelingen zijn de volgende definities van belang:

De associatieregel $X \Rightarrow Y $ betekent: als de deelverzameling $X$ voorkomt dan komt ook de deelverzameling $Y$ voor.

Bijvoorbeeld als ${Melk} \Rightarrow {Melk,Brood}$ betekent dat als melk in een winkelmand zit dan zit er ook brood in. In een winkelmandjes analyse is dit natuurlijk niet altijd waar, maar in de analyse is het van belang om te kijken hoe groot de kans op deze associatieregel is.

De support van een deelverzameling $X$ is het aantal

deelverzamelingen van een collectie $C$ waar de elementen van $X$ in voorkomen gedeeld

door het aantal elementen van deze collectie.

Notatie: $support(X)=\frac{freq(X)}{\#C}$

Hierin is $\mathbf{freq(X)}$ het aantal (frequentie) van de (deel)verzamelingen waarin de elementen van $X$ voorkomen. Support is dus vaktaal voor de kans dat een mandje de (deel)verzameling $X$ bevat.

Bekijk weer de bovenstaande collectie winkelmandjes $D$ dan vind je bijvoorbeeld:

Nog een praktische toepassing: Bij marktonderzoek is de support van een stel artikelen (b.v. $K=\{televisie,surround set\}$) het aantal klanten dat al die artikelen koopt, meestal als percentage van het totaal aantal klanten.

Een stel artikelen $K$ met hoge support (boven een zekere drempel) heet frequent(ofwel ten opzichte van het totaal aantal klanten kopen veel klanten alle artikelen in $K$).

In de winkelmandjesanalyse kan niet altijd alles worden meegenomen. Vaak is men alleen geïnteresseerd in artikelen en combinaties van artikelen die vaak voorkomen en dus frequent

Een itemset is een deelverzameling van elementen uit de een collectie. Een $k$-itemset is een deelverzameling die $k$ elementen bevatten.

In de associatieanalyse (b.v. winkelmandjesanalyse) is het van belang dat men wil handelen op basis van associatieregels. Deze associatieregels stelt men dan op voor frequente deelverzamelingen. Maar dat is niet voldoende, de associatieregel met ook nog interessant zijn, ofwel deze moet een hoge waarschijnlijkheid hebben om maatregelen die genomen woorden op basis van die associatieregels te kunnen onderbouwen. Er moet voldoende dus vertrouwen zijn in de associatieregel. In de vaktaal heet dat de confidence van de associatieregel.

De confidence van de associatieregel $X \Rightarrow Y$ wordt berekend door de support van de

vereniging van $X$ en $Y$ te delen door de support van $X$.

In notatievorm: $confidence(X \Rightarrow Y) = \frac{support(X \cap Y)}{support(X)}$

Omdat $\frac{support(X \cap Y)}{support(X)}=\frac{freq(X \cap Y)}{freq(X)}$, geldt ook:

$confidence(X \Rightarrow Y) =\frac{freq(X \cap Y)}{freq(X)}$

Bij de winkelmandjesanalyse is de confidence een maat voor de kans dat iemand gaat $Y$ kopen, als gegeven is dat hij $X$ al in zijn winkelmandje heeft.

| Collectie $I$ | |

|---|---|

| Id | Items |

| 0 | $\{Pasta,Kaas,Tomaat\}$ |

| 1 | $\{Pasta,Room\}$ |

| 2 | $\{Pasta,Tomaat\}$ |

| 3 | $\{Kaas,Room\}$ |

| 4 | $\{Kaas,Tomaat\}$ |

| 5 | $\{Pasta,Tomaat,Room\}$ |

| 6 | $\{Tomaat,Room\}$ |

| 7 | $\{Kaas,Tomaat\}$ |

| 8 | $\{Pasta,Kaas,Tomaat,Room\}$ |

| 9 | $\{Pasta\}$ |

Er bestaan veel algoritmes om associatieregels te ontdekken. De oudste en meest bekende methode is het Apriori algoritme

(a priori bekent: op basis van eerder onderzoek) ontwikkeld voor transacties (verkopen). Het is in de jaren negentig bedacht door Agrawal en anderen.

Met het algoritme wordt je in staat gesteld om interessante voldoende voorkomende verbanden (implicaties) in een collectie te vinden (b.v. welke aankopen van anderen toon ik jou als jij net in de online winkel een slaapzak koopt?). Voldoende voorkomend (frequent) betekent in dit geval dat we niet alle

verbanden even nuttig vinden. Als producten te weinig voorkomen, ofwel te

weinig support hebben, dan nemen we die niet mee in het algoritme.

We stellen dus een ondergrens aan het support (minimaal support).

Naast dit minimale support kun je ook instellen hoe betrouwbaar de implicaties moeten zijn (hoe sterk zijn de aanwijzingen), ofwel je geeft een minimale confidence op.

In deze fase gebruikt het Apriori algoritme een "bottom up" aanpak op de collectie $C$.

Van te voren kies je een minimale support (minimale aanwezigheid) en bouwen we een collectie $F$ met deelverzamelingen in $C$ met voldoende support. Dit doen we als volgt (zie ook de flowchart hiernaast):

Je begint een nog lege collectie $F$ en met de 1-itemset $S_{1}$. De collectie $S_{1}$ bestaat dan uit alle verzamelingen met slechts één item. (b.v. alle verschillende artikelen in de winkelmandjes). Vervolgens bereken je de support voor al verzamelingen in $S_{1}$ ten opzichte van $C$. Daarna haal je uit $S_{1}$ alle verzamelingen met voldoende support (groter of gelijk aan de minimale support) en voeg die toe aan $F$.

Met de elementen in de verzamelingen in $F$ stel je nu de 2-itemset $S_{2}$ op (dus verzamelingen met twee verschillende artikelen). De support van alle verzamelingen in $S_{2}$ wordt berekend en verzamelingen uit $S_{2}$ met voldoende support worden weer toegevoegd aan $F$.

Dit proces wordt net zolang herhaald tot er in een k-itemset geen verzamelingen met voldoende support meer zijn en er dus niets meer aan $F$ kan worden toegevoegd.Het Apriori algoritme is dus gebaseerd op de volgende observatie: Iedere deelverzameling van een frequente itemset (voldoende voorkomende itemset) is zelf ook weer een frequente itemset. Als b.v. $\{Melk,Kaas\}$ in $F$ aanwezig is dan zijn de verzamelingen $\{Melk\}$ en $\{Kaas\}$ ook aanwezig.

Voor we verder gaan met fase twee in het Apriori algortime bekijken we eerst een voorbeeld voor fase 1.

| Collectie $C$ | |

|---|---|

| Id | Items |

| 0 | $\{Spaghetti, Tomatensaus\}$ |

| 1 | $\{Spaghetti, Brood\}$ |

| 2 | $\{Spaghetti, Tomatensaus, Brood \}$ |

| 3 | $\{Brood,Boter\}$ |

| 4 | $\{Brood, Tomatensaus\}$ |

Stel je hebt als winkel een groot aantal verkopen per klant, (Collectie $C$)

Vraag: Genereer de grootste k-itemsets met behulp van het Apriori-algoritme. Zorg voor een minimale support van 40%.

Iteratie met k=1

| Itemset | Support |

|---|---|

| $\{Spaghetti\}$ | 60% |

| $\{Tomatensaus\}$ | 60% |

| $\{Brood \}$ | 80% |

| $\{Boter\}$ | 20% |

Iteratie met k=2

| Itemset | Support |

|---|---|

| $\{Spaghetti, Tomatensaus \}$ | 40% |

| $\{Spaghetti, Brood \}$ | 40% |

| $\{Tomatensaus, Brood \}$ | 40% |

Iteratie met k=3

| Itemset | Support |

|---|---|

| $\{Spaghetti,Tomatensaus, Brood\}$ | 20% |

Na het einde bestaat de uiteindelijke set van voldoende frequente verzamelingen uit

$F=\{\{Spaghetti\}, \{Tomatensaus\}, \{Brood\}, \{Spaghetti,Tomatensaus\}, \{Spaghetti, Brood \}, \{Tomatensaus, Brood \}\}$.

Als de collectie $F$ is gevonden kunnen we met de verzamelingen in $F$ associatieregels gaan maken. Voor associatieregel bepalen we de confidence. Alleen in die associatieregels met voldoende confidence zijn we geïnteresseerd. We gaan dit duidelijker maken met het voorbeeld hierboven.

Uit $F$ kunnen we de onderstaande associateregels afleiden. Stel dat we associatieregels alleen interessant als de betrouwbaarheid (confidentie) groter is dan 60% (= minimale confidentie).

| Associatieregels | Confidence |

|---|---|

| $\{Spaghetti\} \Rightarrow \{Spaghetti,Tomatensaus\}$ | $\frac{40}{60}= 67 \% $ |

| $\{Spaghetti\} \Rightarrow \{Spaghetti,Brood\}$ | $\frac{40}{60}= 67\% $ |

| $\{Brood\} \Rightarrow \{Spaghetti,Brood\}$ | $\frac{40}{80}= 50\% $ |

| $\{Brood\} \Rightarrow \{Tomatensaus,Brood\}$ | $\frac{40}{80}= 50\% $ |

| $\{Tomatensaus\} \Rightarrow \{Tomatensaus,Brood\}$ | $\frac{40}{60}= 67\% $ |

| $\{Tomatensaus\} \Rightarrow \{Tomatensaus,Spaghetti\}$ | $\frac{40}{60}= 67\% $ |

In de eerste regel in de tabel hierboven geeft voor associatieregel $\{Spaghetti\} \Rightarrow \{Spaghetti,Tomatensaus\}$ een betrouwbaarheid van 67%. Dit zegt dat in 67% van de gevallen dat een klant spaghetti koopt, deze ook tomatensaus gaat kopen. 67% is groter dan 60%, voldoende betrouwbaar dus. De derde regel laat zien dat als iemand brood koopt, deze persoon in 50% van de gevallen spaghetti koopt, te weinig voorspellend om rekening mee te houden want kleiner dan 60%.

Tijd om dit zelf toe te passen:

| Collectie $W$ | |

|---|---|

| Id | Items |

| 0 | $\{a,b,c\}$ |

| 1 | $\{b,c,d,e\}$ |

| 2 | $\{c,d \}$ |

| 3 | $\{a,b,d\}$ |

| 4 | $\{a,b,c\}$ |

| Itemset | Support |

|---|---|

| $\{a\}$ | 60% |

| $\{b\}$ | 80% |

| $\{c \}$ | 80% |

| $\{d\}$ | 60% |

| $\{e\}$ | 20% |

Iteratie met k=2

| Itemset | Support |

|---|---|

| $\{a,b\}$ | 60% |

| $\{a,c\}$ | 40% |

| $\{a,d\}$ | 20% |

| $\{b,c\}$ | 60% |

| $\{b,d\}$ | 40% |

| $\{c,d\}$ | 40% |

Iteratie met k=3

| Itemset | Support |

|---|---|

| $\{a,b,c\}$ | 40% |

De uiteindelijke set van voldoende frequente verzamelingen is

$F=\{\{a\}, \{b\}, \{c\}, \{d\}, \{a, b \}, \{b, c \}\}$.

De daaruit voortvloeiende associatieregels met voldoende confidence zijn

| Associatieregels | Confidence |

|---|---|

| $\{a\} \Rightarrow \{a,b\}$ | $\frac{60}{60}= 100 \% $ |

| $\{b\} \Rightarrow \{a,b\}$ | $\frac{60}{80}= 75 \% $ |

| $\{b\} \Rightarrow \{b,c\}$ | $\frac{60}{80}= 75 \% $ |

| $\{c\} \Rightarrow \{b,c\}$ | $\frac{60}{80}= 75 \% $ |

| Collectie $P$ | |

|---|---|

| Id | Items |

| 0 | $\{brood,melk\}$ |

| 1 | $\{brood,luier,bier,eieren\}$ |

| 2 | $\{melk,luier,bier,cola \}$ |

| 3 | $\{brood,melk,luier,bier\}$ |

| 4 | $\{brood,melk,luier,cola\}$ |

| Itemset | Support |

|---|---|

| $\{brood\}$ | 80% |

| $\{bier\}$ | 60% |

| $\{melk \}$ | 60% |

| $\{luier\}$ | 80% |

| $\{cola\}$ | 40% |

| $\{eieren\}$ | 20% |

Iteratie met k=2

| Itemset | Support |

|---|---|

| $\{brood,bier\}$ | 40% |

| $\{brood,melk\}$ | 60% |

| $\{brood,luier\}$ | 60% |

| $\{bier,melk\}$ | 40% |

| $\{bier,luier\}$ | 60% |

| $\{melk,luier\}$ | 60% |

Iteratie met k=3

| Itemset | Support |

|---|---|

| $\{brood,melk,luier\}$ | 40% |

| $\{brood,melk,bier\}$ | 20% |

| $\{bier,melk,luier\}$ | 40% |

De uiteindelijke set van voldoende frequente verzamelingen is

$F=\{\{brood\}, \{bier\},\{ melk \}, \{luier \},\{brood,melk\}, \{brood,luier\}, \{bier,luier\}

, \{melk,luier\}\}$.

De daaruit voortvloeiende associatieregels met voldoende confidence zijn

| Associatieregels | Confidence |

|---|---|

| $\{brood\} \Rightarrow \{brood,melk\}$ | $\frac{60}{80}= 75 \% $ |

| $\{brood\} \Rightarrow \{brood,luier\}$ | $\frac{60}{80}= 75 \% $ |

| $\{melk\} \Rightarrow \{brood,melk\}$ | $\frac{60}{80}= 75 \% $ |

| $\{melk\} \Rightarrow \{luier,melk\}$ | $\frac{60}{80}= 75 \% $ |

| $\{luier\} \Rightarrow \{luier,brood\}$ | $\frac{60}{80}= 75 \% $ |

| $\{luier\} \Rightarrow \{luier,bier\}$ | $\frac{60}{80}= 75 \% $ |

| $\{luier\} \Rightarrow \{luier,melk\}$ | $\frac{60}{80}= 75 \% $ |

| $\{bier\} \Rightarrow \{bier,luier\}$ | $\frac{60}{60}= 100 \% $ |